文章目录

graph TB

A[/超级人工智能诞生前/] ==> B[Ilya 向董事会通报]

B --> C[董事会成员有的感到震惊\n有的对于被排除在外感到不悦]

C --> D[决定解雇一直在积极推动扩张的 Sam]

D --> E[董事会意识到了自己的错误]

E --> F[Sam 希望掌握控制权,但董事会并不想放手]

F --> G([微软出现,扮演了救世主角色])

G --> H[Sam 接受了微软的提议]

H --> |微软市值飙升+员工集体辞职| I(Ilya 意识到了自己的错误)

I --> J((End ?))

style A fill:#00758f,stroke:#333,stroke-width:2px

style G color:#fff,stroke-dasharray: 5 5

最新采访

不同的声音1

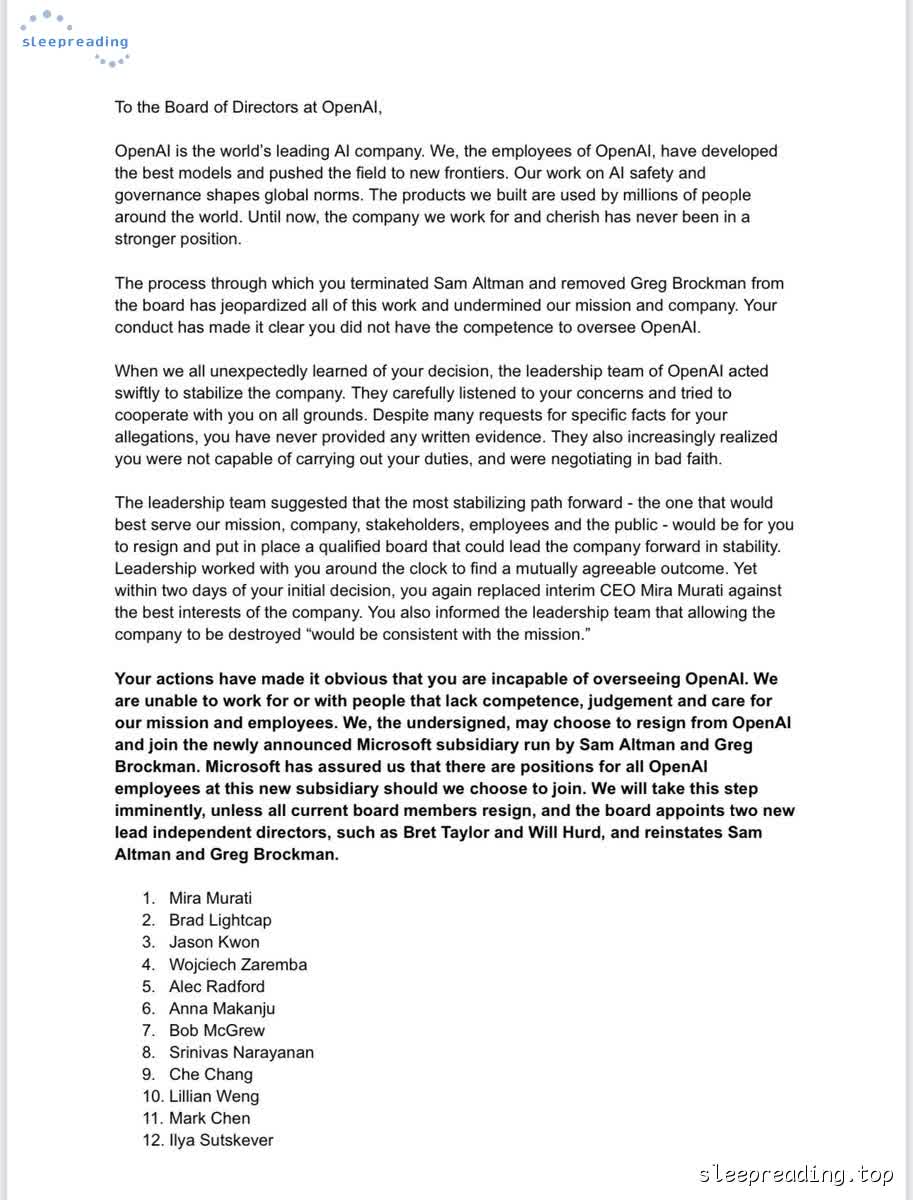

500多名OpenAI员工签署联名信. 据悉, 目前联名信以上升到721人

Will Knight: 721 out of 770 have now signed a letter threatening to quit OpenAI unless Sam Altman is reinstated. That’s almost 95 percent of the company.

不同的声音2

来自Google DeepMind 的可扩展对齐项目主管(Geoffrey Irving)的不同声音:

关于 OpenAI 董事会解雇 Sam 的细节我一无所知,我(Google DeepMind 的可扩展对齐项目主管)对此感到左右为难。但是,鉴于对我极具影响力的人,特别是 Helen Toner 和 Ilya Sutskever 面临的强烈指责,我觉得有必要表达我的看法。 首先,这些仅代表我个人的观点,并非我的雇主的立场。但是,由于潜在的利益冲突,这些观点需要持有一定的保留。 其次,我原本非常支持 Helen 和 Ilya(对另外两位不太了解)。Ilya 是一位杰出的机器学习(ML)研究者,我曾有幸近距离观察他两年的安全观念不断进步,据我所知,这种进步在我 2019 年离开后仍在继续。 Helen 是一位卓越的战略和综合研究员,思考极其缜密,自从我 2018 年认识她以来,我们的交流始终非常愉快。她接受董事会职位时持有保留态度…… ……那时,我曾建议她不要接受,因为我认为治理结构存在问题,但她和其他我信任的人士认为董事会中增加更多独立成员很重要(回顾过去,我还不确定谁的决定是正确的)。 第三,经过两年在 OpenAI 为 Sam 工作的经历,我对他持有强烈的负面看法:

- 他对我一直很友好。

- 但他曾多次对我撒谎。

- 他对其他人,包括我亲近的朋友们,表现出欺骗、操纵甚至更糟糕的行为(再次提及,他只对我友好,出于某些原因)。 “他对我一直很友好”这一点让我处于一个尴尬的境地:我所知道的大部分负面信息都与其他人有关,即便他对我撒谎,也总是试图利用这些谎言在人们之间制造隔阂。因此,我觉得单方面透露这些信息很不妥。 正如我所述,除了已公开的信息外,我对董事会采取行动的具体原因一无所知。对于上周五和周末发生的事情,我感到非常迷惑:从公开信息看,似乎发生了一些重大的战术和战略错误…… ……但这与涉及人员的审慎思考似乎不符。目前,我的立场是在获取更多信息之前保持审慎的判断。我明白这对许多人来说可能显得不太合理,但这是我目前能提出的最佳建议。